Retrieval-Augmented Generation (RAG)

В сфере генеративного искусственного интеллекта (ИИ) технология Retrieval-Augmented Generation (RAG) стала одной из наиболее важных архитектурных решений, позволяющих предприятиям преодолеть ограничения больших языковых моделей (LLM) и раскрыть истинный потенциал своих данных. RAG — это не отдельная модель, а фреймворк, который объединяет генеративные способности LLM с точностью и актуальностью систем извлечения информации, таких как поисковые системы и базы данных.1 Этот симбиоз позволяет создавать ИИ-системы, которые являются не только более точными и надежными, но и глубоко интегрированными в уникальный контекст и базу знаний конкретной организации.

Основная концепция: объединение генеративного ИИ с внешними знаниями

В основе RAG лежит простой, но важный принцип: прежде чем сгенерировать ответ, LLM должна обратиться к авторитетному внешнему источнику знаний.3 Этот процесс, известный как «заземление» (grounding), гарантирует, что ответы модели основаны на проверенных фактах, а не только на информации, усвоенной в ходе ее первоначального обучения. Такой подход напрямую решает несколько ключевых проблем, присущих стандартным LLM.

Во-первых, LLM ограничены своими статичными обучающими данными, что приводит к так называемой «дате отсечения знаний» (knowledge cutoff). Информация, появившаяся после этой даты, им недоступна, что делает их ответы устаревшими и потенциально неточными в быстро меняющихся областях.1 RAG решает эту проблему, предоставляя LLM доступ к свежей, актуальной информации в режиме реального времени во время выполнения запроса.1

Во-вторых, LLM склонны к «галлюцинациям» — генерированию правдоподобной, но фактически неверной или полностью вымышленной информации.9 Это происходит, когда модель не может найти релевантный ответ в своих параметрах и вместо этого «придумывает» его. RAG значительно снижает этот риск, предоставляя модели конкретные, проверяемые фрагменты информации в качестве контекста, на котором она должна основывать свой ответ. Это повышает фактическую точность и укрепляет доверие к ИИ-системе.1

И, Наконец, RAG позволяет LLM работать с узкоспециализированными или проприетарными данными организации, не требуя дорогостоящего и трудоемкого процесса дообучения или полной перетренировки модели. Это делает технологию доступной для создания специализированных чат-ботов, систем поддержки и внутренних баз знаний, которые «говорят на языке» компании и понимают ее уникальные процессы и продукты.4

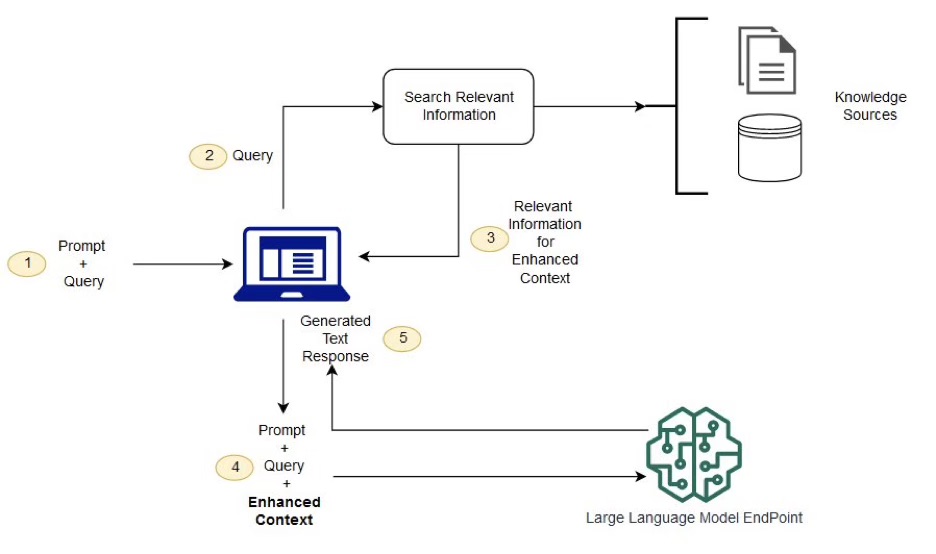

Рабочий процесс RAG: от запроса до обоснованного ответа

Канонический процесс RAG можно разбить на три последовательных этапа, каждый из которых играет решающую роль в преобразовании пользовательского запроса в точный и контекстуально-зависимый ответ.

Этап 1 — Прием и обработка данных (создание библиотеки знаний)

Все начинается с внешних данных, которые могут поступать из различных источников: API, корпоративных баз данных, репозиториев документов или веб-сайтов.4 Эти данные, часто неструктурированные, проходят через процесс подготовки.

- Сегментация (Chunking)

Большие документы разбиваются на более мелкие, семантически связные фрагменты или «чанки».5 Размер чанка является важным параметром, который влияет на качество последующего поиска. - Векторизация (Embedding)

Специализированная модель ИИ, называемая моделью встраивания (embedding model), преобразует каждый текстовый чанк в числовое представление — вектор.4 Этот вектор высокой размерности фиксирует семантическое значение текста, позволяя сравнивать фрагменты по смыслу, а не только по ключевым словам.

Этап 2 — Индексация и извлечение (поиск)

Полученные векторы хранятся и индексируются в специализированной базе данных, называемой векторной базой данных (например, Milvus, Pinecone, Weaviate).1 Эти базы данных оптимизированы для сверхбыстрого поиска сходства в многомерных пространствах.

- Обработка запроса

Когда пользователь отправляет запрос, он также преобразуется в вектор с помощью той же модели встраивания.4

- Семантический поиск

Система выполняет поиск релевантности, сравнивая вектор запроса с векторами в базе данных, чтобы найти наиболее семантически близкие чанки текста.4 Современные системы часто используют гибридный поиск, который сочетает семантический (векторный) и традиционный поиск по ключевым словам для повышения точности и полноты результатов.1

Этап 3 — Дополнение и генерация (ответ)

На заключительном этапе извлеченная информация используется для формирования ответа.

- Дополнение промпта

Наиболее релевантные извлеченные текстовые чанки собираются и вставляются в контекстное окно промпта вместе с исходным запросом пользователя. Этот процесс является ключевым элементом инженерии промптов (prompt engineering).4 - Генерация ответа

Этот дополненный промпт отправляется в LLM. Модель использует предоставленный контекст как «источник истины» для генерации связного, точного и контекстуально-зависимого ответа.1 Часто ответ сопровождается ссылками на исходные документы, что обеспечивает прозрачность, проверяемость и возможность аудита.5]

Рисунок 1 — Типичные процесс RAG

Ключевые преимущества: точность, своевременность и экономическая целесообразность

Внедрение RAG предоставляет предприятиям три стратегических преимущества, которые делают эту технологию краеугольным камнем современного корпоративного ИИ.

- Повышенная точность и доверие

Основывая ответы на конкретных, проверяемых документах, RAG значительно повышает фактическую точность и снижает риск галлюцинаций.1 Это имеет решающее значение для корпоративных приложений, где надежность и достоверность информации являются абсолютным приоритетом. - Доступ к информации в реальном времени

RAG позволяет LLM обойти ограничение по дате отсечения знаний, запрашивая данные из актуальных источников. Это гарантирует, что ответы всегда будут свежими и релевантными, что особенно важно для таких динамичных областей, как финансы, новости или клиентская поддержка.1 - Экономически эффективная специализация

Переобучение или даже тонкая настройка (fine-tuning) базовой модели для получения знаний в определенной предметной области — это дорогостоящий и ресурсоемкий процесс.2 RAG предлагает гораздо более экономичный и гибкий подход для наделения LLM специализированными знаниями из внутренних документов организации или проприетарных баз данных без изменения весов самой модели.2

Сферы применения RAG

Практическая ценность RAG наиболее ярко проявляется в его применениях в различных отраслях. Технология позволяет превратить пассивные хранилища данных в активные, интеллектуальные ресурсы, которые повышают производительность, улучшают качество обслуживания клиентов и способствуют принятию более обоснованных решений. Конкретные примеры внедрения демонстрируют преобразующий потенциал этой архитектуры.

Управление корпоративными знаниями и производительность

Одно из самых мощных применений RAG — это предоставление сотрудникам возможности взаимодействовать с огромными объемами внутренних неструктурированных данных компании с помощью естественного языка. Это превращает разрозненные документы, отчеты и электронные письма в единую, доступную базу знаний.

- Чат-боты для внутренних политик

Телекоммуникационная компания Bell Canada внедрила систему RAG, чтобы предоставить своим сотрудникам доступ к актуальным политикам компании. Это позволило улучшить управление знаниями и повысить операционную эффективность, сократив время на поиск необходимой информации.13 - Усовершенствование технической поддержки

LinkedIn разработала инновационную систему RAG, объединенную с графом знаний, построенным на основе исторических заявок в службу поддержки. Вместо простого текстового поиска система анализирует связи между проблемами. Этот подход позволил повысить точность извлечения информации и сократить среднее время решения проблемы на 28,6%.13 - Универсальные поисковые системы

RAG позволяет создавать мощные внутренние поисковые системы, способные отвечать на вопросы, заданные на естественном языке, по широкому кругу тем — от кадровой политики до технической документации. Это значительно сокращает время ручного поиска и способствует самообслуживанию сотрудников.2

На протяжении десятилетий предприятия накапливали огромные объемы неструктурированных данных, которые часто называют «темными данными» (dark data), поскольку их ценность оставалась нераскрытой. Традиционные методы поиска неэффективны для их анализа. RAG впервые предоставляет масштабируемый механизм для извлечения скрытой ценности из этих данных. Делая их семантически доступными для поиска через естественный язык, RAG превращает «озеро данных» (data lake) в «озеро знаний» (knowledge lake). Пример LinkedIn является идеальной иллюстрацией: старые заявки в службу поддержки были преобразованы из исторического архива в живой граф знаний, который активно помогает сокращать время решения будущих проблем. RAG фундаментально меняет экономическую ценность данных компании. Каждый документ, загруженный в систему RAG, становится частью коллективного «мозга» компании, напрямую способствуя повышению операционной эффективности, удовлетворенности клиентов и достижению конкурентного преимущества.

Системы взаимодействия с клиентами

RAG позволяет компаниям предоставлять своим клиентам более точные, персонализированные и контекстуально-зависимые услуги, повышая их удовлетворенность и лояльность.

- Продвинутая поддержка клиентов

Компания DoorDash разработала сложный чат-бот на базе RAG для своих курьеров («Dasher»). Система включает в себя механизмы контроля качества, такие как LLM Guardrail (для проверки соответствия политикам) и LLM Judge (для оценки точности), что обеспечивает высокое качество ответов.13 - Электронная коммерция и розничная торговля

RAG может использоваться для создания рекомендательных систем, которые извлекают в реальном времени информацию о продуктах, предпочтениях пользователей и складских запасах. Это позволяет генерировать высоко персонализированные и релевантные предложения, выходя за рамки традиционных методов коллаборативной фильтрации.14 - Финансовые услуги

Агентство Bloomberg использует RAG для обобщения объемных финансовых документов, таких как отчеты о прибылях и убытках. Система извлекает самые свежие рыночные данные, предоставляя аналитикам контекстуально-зависимые сводки в реальном времени для более быстрого принятия решений.14

Специализированные профессиональные области

В отраслях, требующих глубоких и специфических знаний, RAG выступает в роли мощного инструмента, который расширяет возможности профессионалов, предоставляя им мгновенный доступ к огромным массивам информации.

- Здравоохранение и медико-биологические науки

Системы RAG могут запрашивать обширные базы данных медицинской литературы, клинических рекомендаций и электронных медицинских карт, чтобы помочь врачам в диагностике и планировании лечения. Ярким примером в этой области является IBM Watson Health.14 - Юридические исследования и анализ

RAG оптимизирует юридические исследования, извлекая релевантные прецеденты, законы и сложные юридические документы. Это помогает юристам более эффективно составлять документы и формулировать аргументы.11 - Образование

RAG может лежать в основе интеллектуальных систем обучения, которые предоставляют персонализированные инструкции и обратную связь в реальном времени, черпая информацию из обширного корпуса учебных материалов.11

Первоначальный ажиотаж вокруг ИИ часто был сосредоточен на полной автоматизации. Однако наиболее эффективные реальные приложения RAG, такие как в Bloomberg, здравоохранении и юриспруденции, спроектированы как «вторые пилоты» или инструменты дополнения. Финансовый аналитик использует RAG, чтобы быстрее получать сводки, но его опыт по-прежнему необходим для принятия окончательного решения. Врач использует RAG для поддержки диагностики, но окончательное решение принимает человек.15 Эта модель дополнения более эффективна, поскольку она сочетает скорость и широту доступа к данным LLM с тонким суждением, этическими соображениями и контекстуальным пониманием человека. Это также снижает риски, связанные с опорой исключительно на ИИ при принятии критически важных решений. Стратегическая ценность RAG максимизируется, когда он внедряется как инструмент для повышения производительности и качества принятия решений квалифицированными специалистами.

Новые и ресурсоемкие приложения

Помимо устоявшихся областей, RAG находит применение в решении сложных задач анализа данных в реальном времени.

- Обнаружение мошенничества

RAG улучшает модели обнаружения мошенничества, динамически включая актуальную внешнюю информацию, такую как новые схемы мошенничества или изменения в законодательстве. Это приводит к более высоким показателям обнаружения по сравнению с традиционными моделями машинного обучения.14 - Мультимодальный поиск

RAG не ограничивается текстом. Используя мультимодальные модели встраивания, его можно применять для поиска и генерации ответов на основе изображений, аудио- и видеоконтента. Это открывает возможности для таких мощных приложений, как поиск и обобщение видео.1

Эволюция архитектур RAG

По мере того как RAG переходил от академических исследований к производственным системам, его архитектура претерпела значительную эволюцию. Понимание этих изменений — от простых линейных конвейеров до сложных модульных и агентных фреймворков — имеет решающее значение для создания надежных и масштабируемых корпоративных ИИ-решений.

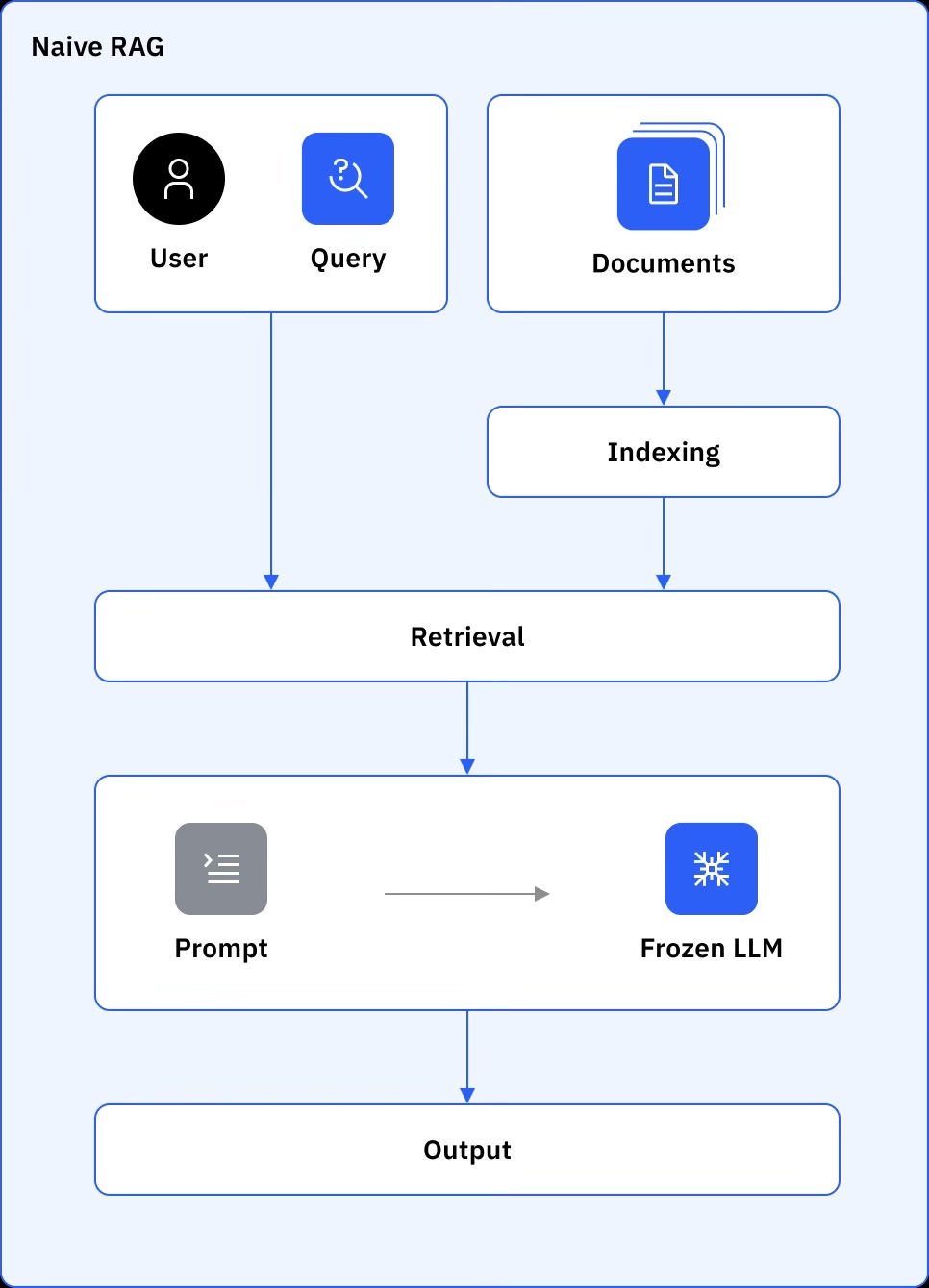

Базовая парадигма: наивный RAG

Наивная (Naive) RAG — это самая простая реализация, часто используемая для первоначальной проверки концепции (Proof-of-Concept). Она следует прямому, линейному конвейеру, также известному как фреймворк «Извлеки-Прочти» (Retrieve-Read).17

Рисунок 2 — наивный RAG

- Архитектура Процесс состоит из трех последовательных шагов: индексация, извлечение и генерация.

Документы сегментируются, векторизуются и сохраняются. Запрос пользователя используется

для извлечения K наиболее похожих чанков на основе одного показателя сходства.

Эти чанки затем объединяются и передаются в LLM. - Ограничения Несмотря на простоту реализации, наивная RAG сталкивается с серьезными проблемами

в производственных средах. Ключевые недостатки включают:- Низкая точность извлечения Часто извлекаются нерелевантные или лишь частично релевантные чанки,

что вносит «шум» в контекст LLM и снижает качество ответа. - Проблемы с интеграцией контекста LLM может испытывать трудности с синтезом информации из разрозненных

или повторяющихся чанков, что приводит к несвязным ответам. - Склонность к галлюцинациям Если извлеченный контекст низкого качества или неполон, LLM может

вернуться к своим параметрическим знаниям и сфабриковать информацию,

сводя на нет основное преимущество RAG.

- Низкая точность извлечения Часто извлекаются нерелевантные или лишь частично релевантные чанки,

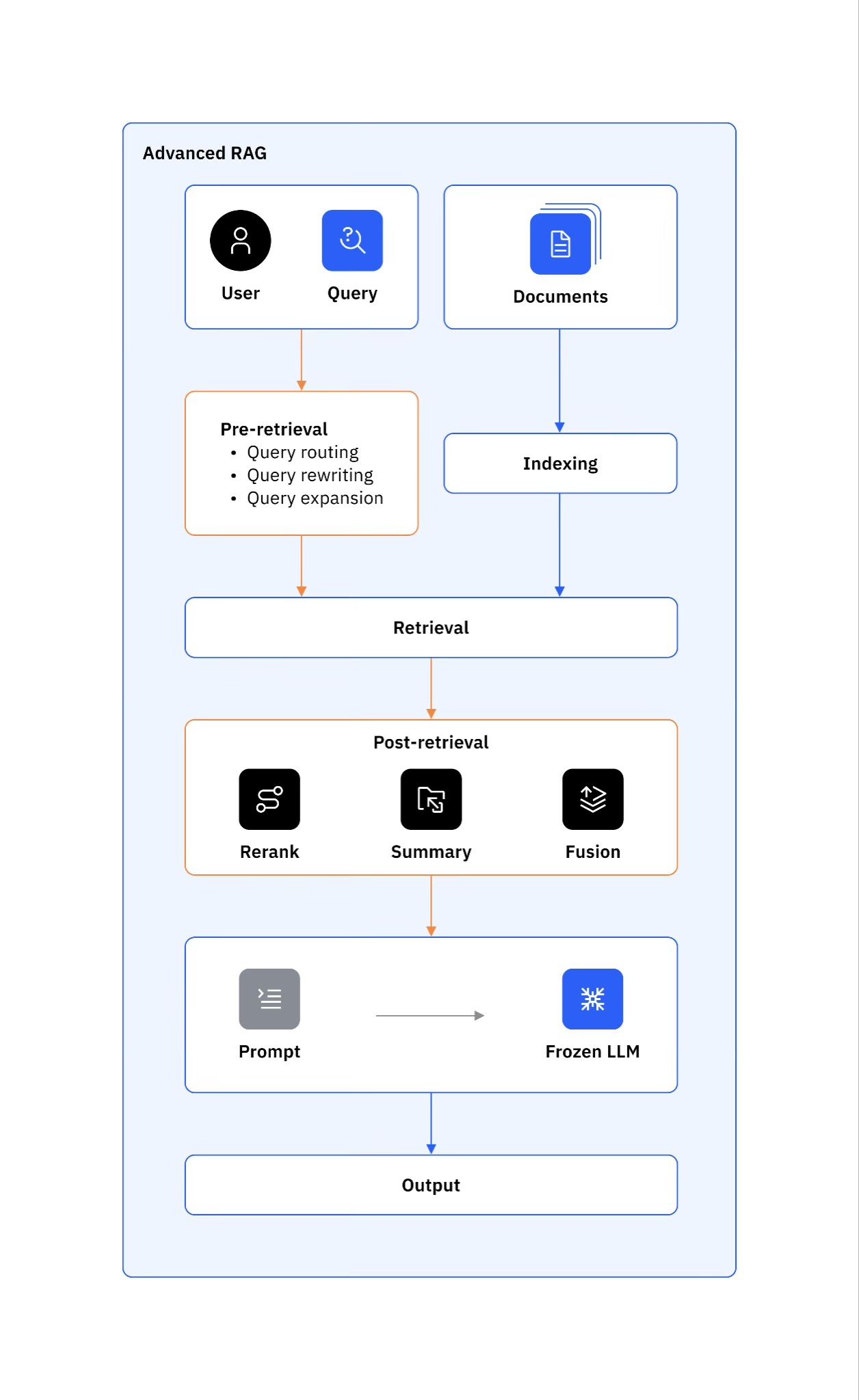

Продвинутый RAG

Продвинутый (Advanced) RAG представляет собой эволюцию, которая вводит этапы оптимизации до и после основного этапа извлечения, чтобы значительно повысить качество контекста, предоставляемого LLM.17

Рисунок 3 — продвинутый RAG

- Архитектура Это уже не простой линейный процесс, а многоступенчатый конвейер,

включающий шаги по предварительной и последующей обработке. - Ключевые техники:

- Оптимизация перед извлечением

- Эти методы направлены на улучшение как индексации данных, так и самого

пользовательского запроса.- Стратегии индексации Оптимизация размера чанков, использование «скользящих окон» для

создания пересечений между чанками для лучшей связности, а также

добавление метаданных (например, дат, источников, разделов) для

более точной фильтрации при поиске. - Преобразование запросов Использование LLM для переформулирования или расширения исходного

запроса пользователя, чтобы сделать его более конкретным. Сложный

вопрос может быть разбит на несколько подзапросов, что приводит к

более целенаправленному извлечению.

- Стратегии индексации Оптимизация размера чанков, использование «скользящих окон» для

- Обработка после извлечения Эти методы направлены на очистку и приоритизацию извлеченных

документов перед их передачей в LLM.- Переранжирование (Reranking) Это критически важный шаг. После первоначального извлечения

большего набора документов (например, топ-50) используется более

сложная и вычислительно затратная модель переранжирования. Эта

модель повторно оценивает и ранжирует документы специально по их

релевантности к запросу. Это гарантирует, что окончательный,

меньший набор чанков (например, топ-5), передаваемый в LLM,

имеет максимально возможное качество. - Сжатие контекста Обобщение или сжатие извлеченной информации, чтобы она

поместилась в контекстное окно LLM без потери критически

важных деталей.

- Переранжирование (Reranking) Это критически важный шаг. После первоначального извлечения

- Циклы обратной связи

- Включение обратной связи от пользователей (явные оценки или

неявные сигналы, такие как клики) для постоянного улучшения

моделей извлечения и переранжирования с использованием таких

методов, как обучение с подкреплением (Reinforcement Learning).

Модульный и агентный RAG

Самая продвинутая парадигма отходит от фиксированного, линейного конвейера к гибкой, динамической архитектуре, где различные модули и инструменты могут быть оркестрованы для обработки сложных запросов.17

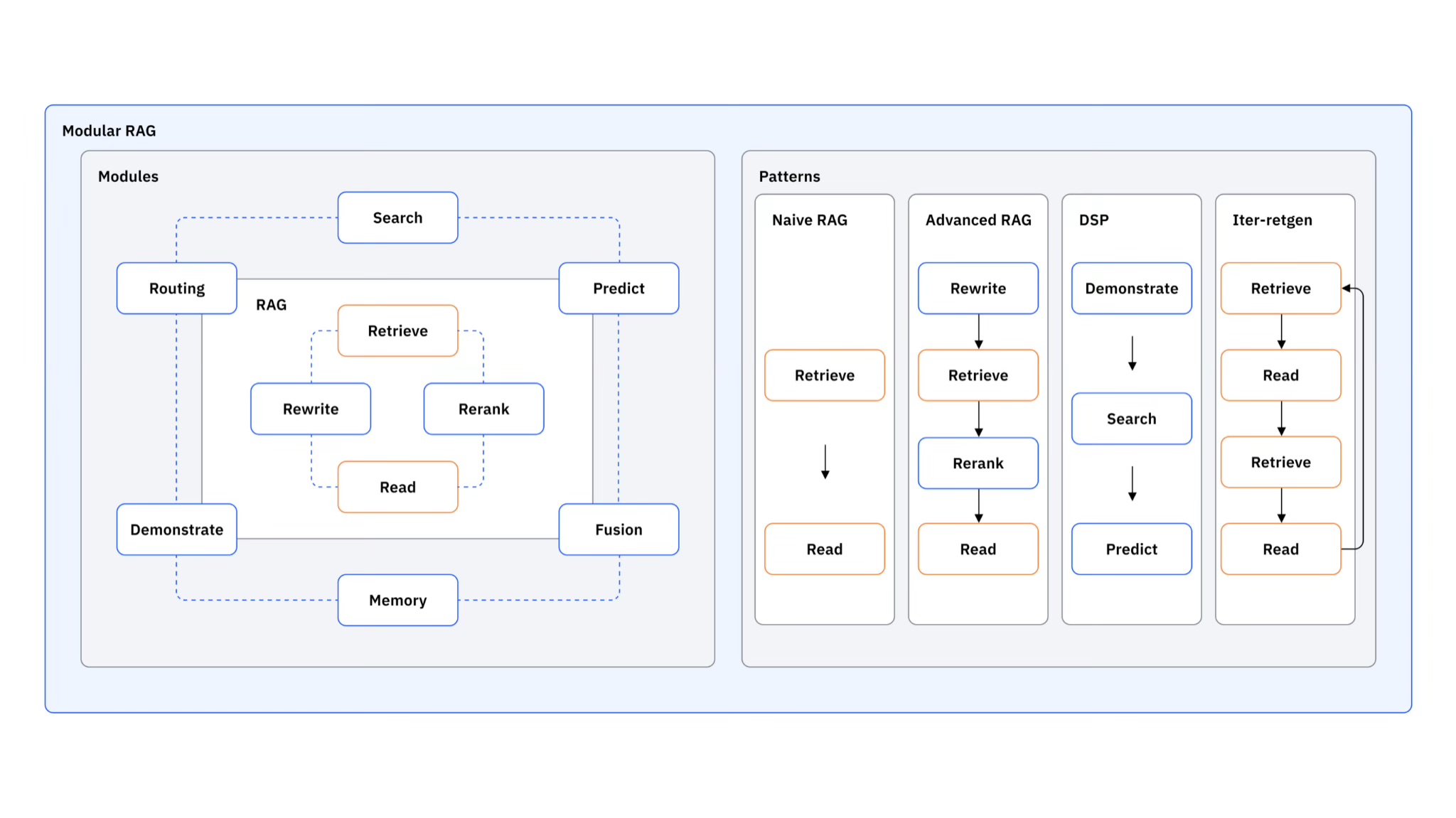

Рисунок 4 — Модульный RAG

- Модульный RAG Эта архитектура включает в себя набор специализированных, взаимозаменяемых

компонентов.- Модуль поиска Может запрашивать несколько источников, помимо одной векторной базы

данных, включая традиционные поисковые системы, структурированные

базы данных или графы знаний. - Модуль памяти Сохраняет контекст в ходе многоходовых диалогов для более связного

взаимодействия. - Модуль маршрутизации Компонент принятия решений, который анализирует запрос пользователя и

определяет наилучший путь — например, простое извлечение, поиск в вебе

или прямая генерация без извлечения.

- Модуль поиска Может запрашивать несколько источников, помимо одной векторной базы

- Агентный RAG Вершина этой эволюции, где агент на базе LLM активно рассуждает о

проблеме. Вместо того чтобы просто извлекать и дополнять, агент может

итеративно использовать набор инструментов (например, вызовы функций для

извлечения).Он может оценивать извлеченную информацию, выявлять пробелы и принимать

решение о выполнении дополнительных шагов по извлечению, чтобы уточнить

свои знания перед генерацией окончательного ответа. Это добавляет уровень

рассуждений и стратегии в процесс сбора информации.

Эволюция от наивного к модульному RAG отражает зрелость разработки программного обеспечения, которая прошла путь от монолитных скриптов к архитектурам на основе микросервисов. Наивный RAG подобен простому монолитному скрипту: он выполняет одну функцию в линейной последовательности. Его легко создать, но он хрупок и его трудно масштабировать или улучшать. Продвинутый RAG — это как рефакторинг этого скрипта в отдельные функции (предварительное извлечение, извлечение, последующая обработка), что повышает модульность и позволяет целенаправленно оптимизировать каждую часть. Модульный RAG — это полное принятие микросервисной архитектуры. Каждый компонент (поиск, память, маршрутизация) является отдельным, заменяемым сервисом, а оркестратор направляет трафик между ними. Этот архитектурный прогресс приносит те же преимущества, что и в разработке ПО: гибкость, масштабируемость и отказоустойчивость. Для создания RAG-систем производственного уровня организации должны принять мышление инженеров-программистов.

Появление агентного RAG означает, что процесс «извлечения» становится задачей автономного рассуждения, что коренным образом увеличивает сложность и вычислительные затраты на один запрос. В наивном и продвинутом RAG запрос пользователя запускает предсказуемую, конечную последовательность операций. В агентном RAG агент может решить выполнить несколько шагов извлечения, уточнить свои собственные запросы или даже запрашивать разные источники в цикле, пока не будет «удовлетворен» собранной информацией.19 Это означает, что один запрос пользователя может вызвать каскад из нескольких вызовов LLM и операций извлечения, что резко увеличивает задержку и стоимость за запрос.19 Это создает новый набор инфраструктурных проблем. Система должна быть способна справляться с непредсказуемыми, пиковыми нагрузками, и производительность компонентов извлечения и генерации становится еще более критичной для управления задержкой.

Экосистема NVIDIA для RAG производственного уровня

Компания NVIDIA, являясь лидером в области аппаратного обеспечения для ИИ, играет стратегическую роль в ландшафте RAG. Ее подход выходит за рамки простого предоставления графических процессоров (GPU); NVIDIA создает комплексную, сквозную программно-аппаратную платформу, предназначенную для ускорения каждого этапа конвейера RAG.

Философия и конвейер RAG от NVIDIA

NVIDIA определяет RAG как ИИ-технику, которая соединяет LLM с внешними данными для генерации ответов, специфичных для предметной области или содержащих самую свежую информацию, в режиме реального времени.10 Компания подчеркивает способность RAG основывать ответы на проприетарных данных и обрабатывать мультимодальный контент, включая текст, изображения и видео.10

Канонический конвейер RAG от NVIDIA структурирован в три ключевые фазы, что соответствует общепринятой практике 10

- Извлечение (Extraction) Прием, преобразование и индексация данных в векторную базу данных.

Эта фаза включает использование моделей встраивания для создания

векторных представлений. - Поиск (Retrieval) Идентификация и извлечение релевантных данных с использованием

векторного и ключевого поиска, за которым следует модель

переранжирования для повышения релевантности. - Генерация (Generation) Объединение промпта пользователя с извлеченными данными для того,

чтобы LLM сгенерировала точный, контекстуально-зависимый ответ.

Основным принципом NVIDIA является применение ускорения на GPU на каждом этапе этого конвейера — от обработки данных и векторизации до векторного поиска и инференса LLM. Это позволяет минимизировать задержки и максимизировать пропускную способность.10

Основные технологии и микросервисы: строительные блоки RAG от NVIDIA

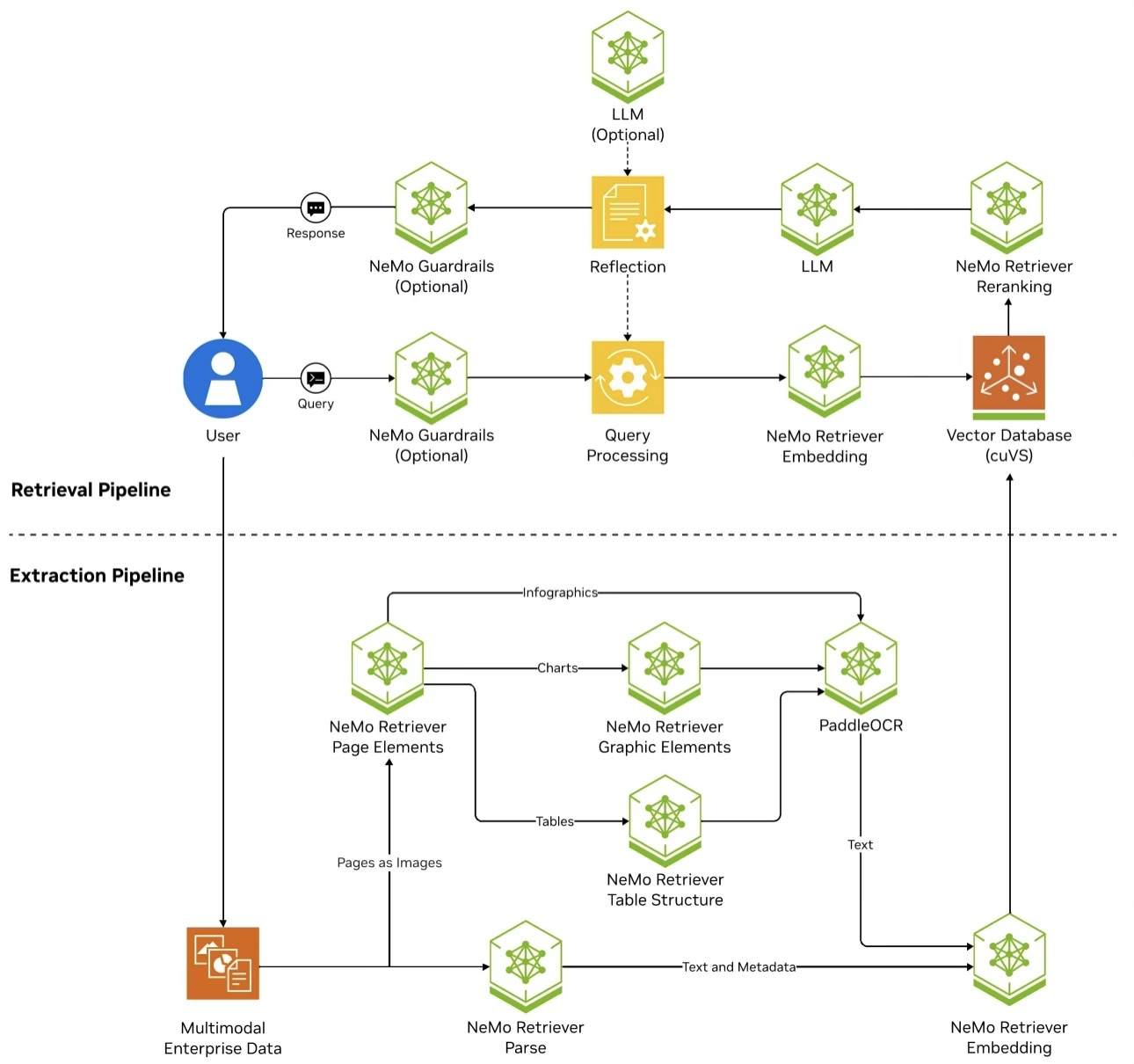

Рисунок 5 — Архитектура RAG NVIDIA

NVIDIA предлагает набор мощных инструментов и фреймворков, которые служат основой для создания высокопроизводительных RAG-систем.

- NVIDIA NeMo™ Это комплексный фреймворк для создания, кастомизации и развертывания

генеративных ИИ-моделей. Для RAG ключевыми компонентами являются:- NeMo Retriever Коллекция генеративных ИИ-микросервисов, специально предназначенных

для фаз извлечения и поиска. Он предоставляет инструменты для

извлечения данных, развертывания моделей встраивания и

высокоточного переранжирования. - NeMo Customizer & Curator Микросервисы, которые упрощают тонкую настройку моделей

встраивания на данных конкретной предметной области и генерацию

синтетических данных для улучшения производительности моделей. - NeMo Evaluator Микросервис для строгой оценки производительности конвейеров

RAG по различным бенчмаркам.

- NeMo Retriever Коллекция генеративных ИИ-микросервисов, специально предназначенных

- NVIDIA NIM™ (NVIDIA Inference Microservices) Это набор простых в использовании, предварительно созданных контейнеров,

которые оптимизируют и ускоряют развертывание ИИ-моделей (включая LLM и

модели встраивания) для инференса. NIM предоставляют стандартизированный,

высокопроизводительный способ обслуживания моделей, используемых в

конвейере RAG. - NVIDIA cuVS Это библиотека с открытым исходным кодом для ускоренного на GPU

векторного поиска. Она значительно ускоряет основной шаг извлечения

в конвейере RAG, перенося вычисления поиска ближайших соседей на GPU.

Это приводит к более высокой пропускной способности и меньшей задержке

по сравнению с векторными базами данных, работающими на CPU.

NVIDIA AI Blueprints: ускорение развертывания

Чтобы упростить внедрение этих технологий, NVIDIA предлагает AI Blueprints — референсные архитектуры, которые объединяют различные технологии NVIDIA в готовое к развертыванию решение для конкретных сценариев использования.16

- Enterprise RAG Blueprint

- Этот конкретный Blueprint предоставляет разработчикам базовую отправную точку для создания масштабируемых, настраиваемых конвейеров RAG. Он интегрирует модели NeMo Retriever, NIM и

- Blueprint поддерживает прием мультимодальных данных (PDF, аудио), гибридный поиск, переранжирование, многоходовые диалоги и включает функции наблюдаемости и безопасности, такие как программируемые защитные механизмы (guardrails).22 Он представляет собой полный, высокопроизводительный стек, от приема данных до генерации ответа, разработанный для работы на аппаратном обеспечении NVIDIA.

Стратегия NVIDIA заключается в создании сквозной, аппаратно-ускоренной «RAG-как-платформы» путем превращения каждого этапа конвейера в оптимизированный для GPU микросервис. NVIDIA признает, что ее основной актив, GPU, может ускорять не только обучение и инференс моделей, но и весь конвейер данных RAG, который является вычислительно интенсивным. Вместо того чтобы просто продавать оборудование, NVIDIA создает комплексный программный слой (NeMo, NIM, cuVS), явно разработанный для оптимальной работы на своих GPU.16 Разбивая рабочий процесс RAG на отдельные микросервисы, NVIDIA облегчает разработчикам внедрение своего стека. Это создает мощную экосистему: хотя компоненты являются модульными, все они оптимизированы для платформы NVIDIA/CUDA. Путь наименьшего сопротивления для достижения высокой производительности — это принятие полного стека NVIDIA. Это классическая платформенная стратегия, которая превращает NVIDIA из поставщика компонентов в провайдера комплексной, интегрированной и оптимизированной платформы для создания и развертывания RAG.

Более того, «Enterprise RAG Blueprint» показывает, что RAG производственного уровня — это не один алгоритм, а сложная, многосервисная система, требующая надежного управления MLOps и инфраструктурой. Сложность этого Blueprint, включающего множество компонентов, подчеркивает нетривиальные операционные задачи: обнаружение сервисов, масштабирование, мониторинг и безопасность для всех этих движущихся частей.22 Включение таких функций, как «Телеметрия и наблюдаемость», подтверждает, что корпоративный RAG — это критически важное приложение, требующее такого же уровня операционной строгости, как и любое другое корпоративное ПО.

Анализ корпоративных платформ данных для RAG

Поскольку RAG становится критически важной корпоративной рабочей нагрузкой, рынок инфраструктуры данных быстро адаптируется для удовлетворения его уникальных и высоких требований. Три ключевых поставщика — VAST Data, WEKA и Hitachi Vantara — разработали специализированные платформы, каждая из которых предлагает свой собственный архитектурный подход к решению проблем производительности, масштабируемости и управляемости RAG в корпоративной среде.

VAST Data — унифицированная платформа данных для ИИ в масштабе

VAST Data предлагает решение, основанное на своей платформе VAST Data Platform, которая использует архитектуру DASE (Disaggregated and Shared-Everything), объединяющую функции хранения, баз данных и вычислений.23 Их готовое к использованию решение для RAG,

VAST InsightEngine, разработано в тесном сотрудничестве с NVIDIA и предназначено для демократизации RAG за счет устранения необходимости в сложной интеграции разрозненных технологий.24

- Архитектура и ключевые отличия:

- Устранение ETL в реальном времени

- Отличительной чертой платформы VAST является индексация данных

непосредственно в источнике. Любое обновление файла или объекта

атомарно синхронизируется со встроенной векторной базой данных и ее

индексами. Это устраняет необходимость в отдельных, пакетных

конвейерах ETL (Extract, Transform, Load) и гарантирует, что система

RAG всегда имеет доступ к самым свежим данным без задержек. - Масштабируемость и унификация данных Платформа спроектирована для масштабирования до экзабайт как

структурированных, так и неструктурированных данных (файлы,

объекты, таблицы) в рамках единого глобального пространства

имен (DataSpace). Это значительно упрощает управление данными

в огромных масштабах. - Интегрированная база данных VAST DataBase является основным компонентом, который объединяет

функции традиционной базы данных, хранилища данных и озера данных

и, по утверждению компании, является первой системой, поддерживающей

поиск в масштабе триллиона векторов.

- Интеграция с NVIDIA VAST Data имеет глубокое партнерство с NVIDIA, интегрируя микросервисы

NVIDIA NIM непосредственно в платформу InsightEngine. Платформа

спроектирована для эффективной подачи огромных наборов данных

на GPU NVIDIA. - Ценностное предложение VAST Data упрощает бэкенд управления данными для крупномасштабных

RAG-систем, объединяя все типы данных и устраняя сложные конвейеры

данных. Это позволяет создавать интерактивные ИИ-процессы в реальном

времени на основе самых актуальных данных.

WEKA: высокопроизводительная платформа данных для RAG с низкой задержкой

WEKA предлагает WEKA AI RAG Reference Platform (WARRP) — референсную архитектуру, построенную на высокопроизводительной платформе WEKA Data Platform.7 Это модульная архитектура, которая интегрирует лучшие в своем классе компоненты для достижения максимальной производительности.

- Архитектура и ключевые отличия:

- Экстремальная производительность Основной фокус WEKA — обеспечение сверхнизкой задержки и высокой

пропускной способности для максимального использования GPU.

Компания заявляет о достижении лучших результатов в бенчмарках

и способности повысить утилизацию GPU с ~30% до более чем 90%. - NVIDIA GPUDirect™ Storage WEKA активно использует технологию GPUDirect, которая позволяет

GPU напрямую получать доступ к данным из хранилища WEKA,

минуя CPU. Это значительно сокращает узкие места в вводе-выводе

и задержки. - Экосистемная интеграция WARRP — это не монолитный стек, а интегрированное решение,

объединяющее WEKA Data Platform с партнерами по экосистеме,

такими как Run:ai для оркестрации GPU и Milvus для управления

векторной базой данных.

- Экстремальная производительность Основной фокус WEKA — обеспечение сверхнизкой задержки и высокой

- Интеграция с NVIDIA Глубокая интеграция с NVIDIA AI Enterprise, NIM и критически

важными технологиями производительности, такими как GPUDirect. - Ценностное предложение WEKA предоставляет самый быстрый из возможных конвейер данных

для рабочих нагрузок RAG, где производительность в реальном

времени имеет первостепенное значение. Платформа оптимизирована

для таких ключевых метрик, как Time-to-First-Token (TTFT),

что делает ее идеальной для интерактивных чат-ботов и других

чувствительных к задержкам приложений.

Hitachi Vantara: отраслевое, корпоративного уровня ИИ-решение

Hitachi Vantara предлагает портфель Hitachi iQ — набор готовых к ИИ инфраструктурных решений, которые сочетают в себе корпоративные платформы хранения данных Hitachi (такие как VSP One и Hitachi Content Software for File — HCSF) с вычислительными мощностями и программным обеспечением NVIDIA.30

- Архитектура и ключевые отличия:

- Корпоративный уровень и отраслевая специфика Hitachi Vantara использует свой многолетний опыт в области

критически важных корпоративных ИТ и операционных технологий (OT)

для предоставления надежных, безопасных и отраслевых решений

(например, для финансов, здравоохранения, производства). - AI Discovery Service Компания предлагает консультационный подход, чтобы помочь клиентам

определить наиболее ценные сценарии использования ИИ и создать

стратегическую дорожную карту. Это выходит за рамки простой продажи

инфраструктуры и представляет собой комплексное решение. - Hitachi iQ Time Machine Уникальная и мощная функция, которая обеспечивает «осведомленный о

времени» RAG. Она позволяет системе RAG запрашивать не только

текущую версию данных, но и их исторические версии, что дает

возможность анализировать, как информация менялась со временем.

Это критически важно для соблюдения нормативных требований,

аудита и анализа первопричин.

- Корпоративный уровень и отраслевая специфика Hitachi Vantara использует свой многолетний опыт в области

- Интеграция с NVIDIA Hitachi Vantara имеет прочное партнерство с NVIDIA, предлагая решения

с сертификацией NVIDIA DGX BasePOD и интегрируя платформы NVIDIA HGX.

Компания перепродает полный стек, включая программное обеспечение

NVIDIA AI Enterprise. - Ценностное предложение Hitachi Vantara поставляет надежную, управляемую и безопасную

ИИ-инфраструктуру для крупных предприятий, особенно в регулируемых

отраслях, с уникальными возможностями для версионирования данных

и фокусом на решении конкретных, высокоценных бизнес-задач.

Сравнительный анализ и рекомендации

Анализ этих трех платформ показывает, что рынок инфраструктуры для RAG сегментируется вокруг трех основных корпоративных проблем: сложности данных, узких мест в производительности и интеграции/управления. VAST Data нацелена на решение проблемы сложности данных в огромных масштабах. WEKA фокусируется на устранении узких мест в производительности для приложений, требующих мгновенного отклика. Hitachi Vantara решает проблему бизнес-интеграции и управления, предлагая надежные и аудируемые решения для крупных, регулируемых предприятий.

Эта сегментация создает своего рода «трилемму» для покупателей, которые должны определить, какая из этих трех основных проблем является наиболее критичной для их успеха. Выбор платформы будет зависеть от конкретных приоритетов и сценариев использования организации.

| Аспект | VAST Data | WEKA | Hitachi Vantara |

| Архитектурная философия | Унифицированная платформа данных: единая, масштабируемая платформа для хранения, баз данных и вычислений. | Высокопроизводительный, композитный стек: референсная архитектура из лучших в своем классе компонентов, ориентированная на скорость и низкую задержку. | Отраслевое, интегрированное решение: сквозной стек корпоративного уровня с акцентом на надежность и услуги. |

| Ключевое отличие | RAG в реальном времени без ETL: Атомарная синхронизация исходных данных со встроенной векторной базой данных. | Экстремальная производительность и низкая задержка: Максимальное использование GPU через GPUDirect Storage; оптимизация под TTFT. | Осведомленный о времени RAG и управление: Функция «Time Machine» для запросов к историческим версиям данных; AI Discovery Service. |

| Интеграция с NVIDIA | Глубокое партнерство; интеграция NVIDIA NIM в готовое решение VAST InsightEngine. | Использование ключевых технологий производительности, таких как GPUDirect; интеграция с NVIDIA AI Enterprise и NIM в рамках WARRP. | Прочное партнерство по перепродаже и интеграции; сертификация NVIDIA DGX BasePOD; интеграция платформ HGX в Hitachi iQ. |

| Целевая рабочая нагрузка | Гипермасштабируемый RAG с огромными, постоянно меняющимися наборами данных, где простота управления данными является ключевым фактором. | Чувствительные к задержкам, интерактивные приложения в реальном времени (например, продвинутые чат-боты, финансовый анализ). | Критически важные корпоративные и промышленные приложения в регулируемых отраслях, требующие аудита и надежности. |

| Основное ценностное предложение | Простота в масштабе: Укрощение сложности данных для массивных ИИ-нагрузок. | Скорость и эффективность: Предоставление самого быстрого конвейера данных для «голодных» GPU. | Доверие и бизнес-ценность: Предоставление надежных, управляемых и адаптированных ИИ-решений, которые решают конкретные проблемы. |

Глубокая интеграция с NVIDIA становится основной проверкой жизнеспособности инфраструктурной платформы для ИИ. Все три поставщика активно подчеркивают свое сотрудничество с NVIDIA, а получение сертификатов, таких как NVIDIA DGX BasePOD, или интеграция технологий, таких как GPUDirect Storage, представляется как критически важный знак одобрения.7 Это связано с тем, что производительность системы RAG в конечном итоге определяется эффективностью перемещения данных к GPU NVIDIA и от них. Таким образом, способность платформы хранения данных тесно интегрироваться с экосистемой NVIDIA больше не является просто «приятной особенностью», а становится фундаментальным предварительным условием для конкурентоспособности на рынке ИИ-инфраструктуры. Это дает NVIDIA значительное влияние, позволяя ей формировать конкурентный ландшафт, выбирая, с какими партнерами сертифицироваться и сотрудничать наиболее тесно.

Источники

- What is Retrieval-Augmented Generation (RAG)? | Google Cloud, дата последнего обращения: сентября 21, 2025, https://cloud.google.com/use-cases/retrieval-augmented-generation

- What is RAG (Retrieval Augmented Generation)? — IBM, дата последнего обращения: сентября 21, 2025, https://www.ibm.com/think/topics/retrieval-augmented-generation

- en.wikipedia.org, дата последнего обращения: сентября 21, 2025, https://en.wikipedia.org/wiki/Retrieval-augmented_generation

- What is RAG? — Retrieval-Augmented Generation AI Explained — AWS — Updated 2025, дата последнего обращения: сентября 21, 2025, https://aws.amazon.com/what-is/retrieval-augmented-generation/

- What is Retrieval Augmented Generation (RAG)? | Databricks, дата последнего обращения: сентября 21, 2025, https://www.databricks.com/glossary/retrieval-augmented-generation-rag

- What Is RAG (Retrieval-Augmented Generation)? A Full Guide — Snowflake, дата последнего обращения: сентября 21, 2025, https://www.snowflake.com/en/fundamentals/rag/

- WEKA AI RAG Reference Platform — WEKA, дата последнего обращения: сентября 21, 2025, https://www.weka.io/resources/white-paper/weka-ai-rag-reference-platform/

- Retrieval Augmented Generation (RAG) and Semantic Search for GPTs, дата последнего обращения: сентября 21, 2025, https://help.openai.com/en/articles/8868588-retrieval-augmented-generation-rag-and-semantic-search-for-gpts

- LLM RAG Paradigms: Naive RAG, Advanced RAG & Modular RAG | by Dr Julija — Medium, дата последнего обращения: сентября 21, 2025, https://medium.com/@drjulija/what-are-naive-rag-advanced-rag-modular-rag-paradigms-edff410c202e

- What is Retrieval-Augmented Generation (RAG)? | NVIDIA Glossary, дата последнего обращения: сентября 21, 2025, https://www.nvidia.com/en-us/glossary/retrieval-augmented-generation/

- 7 Practical Applications of RAG Models and Their Impact on Society — Hyperight, дата последнего обращения: сентября 21, 2025, https://hyperight.com/7-practical-applications-of-rag-models-and-their-impact-on-society/

- Retrieval Augmented Generation: Everything You Need to Know About RAG in AI — WEKA, дата последнего обращения: сентября 21, 2025, https://www.weka.io/learn/guide/ai-ml/retrieval-augmented-generation/

- 10 RAG examples and use cases from real companies — Evidently AI, дата последнего обращения: сентября 21, 2025, https://www.evidentlyai.com/blog/rag-examples

- Top 7 RAG Use Cases and Applications to Explore in 2025 — ProjectPro, дата последнего обращения: сентября 21, 2025, https://www.projectpro.io/article/rag-use-cases-and-applications/1059

- Use cases for Retrieval Augmented Generation — AWS Prescriptive Guidance, дата последнего обращения: сентября 21, 2025, https://docs.aws.amazon.com/prescriptive-guidance/latest/retrieval-augmented-generation-options/rag-use-cases.html

- NVIDIA Retrieval-Augmented Generation Tools and Technologies, дата последнего обращения: сентября 21, 2025, https://developer.nvidia.com/topics/ai/retrieval-augmented-generation

- RAG techniques — IBM, дата последнего обращения: сентября 21, 2025, https://www.ibm.com/think/topics/rag-techniques

- Native RAG vs. Advanced RAG vs. Modular RAG — Zilliz blog, дата последнего обращения: сентября 21, 2025, https://zilliz.com/blog/advancing-llms-native-advanced-modular-rag-approaches

- Advanced & Modular RAG | Pattern & Architectures — AI Technology Radar — AOE GmbH, дата последнего обращения: сентября 21, 2025, https://ai-radar.aoe.com/architecture-pattern/rag/

- Advanced RAG: Techniques, Architecture, and Best Practices — Designveloper, дата последнего обращения: сентября 21, 2025, https://www.designveloper.com/blog/advanced-rag/

- Enterprise Retrieval-Augmented Generation — NVIDIA, дата последнего обращения: сентября 21, 2025, https://resources.nvidia.com/en-us-generative-ai-getting-started

- Build an Enterprise RAG pipeline Blueprint by NVIDIA | NVIDIA NIM, дата последнего обращения: сентября 21, 2025, https://build.nvidia.com/nvidia/build-an-enterprise-rag-pipeline

- VAST Data — Wikipedia, дата последнего обращения: сентября 21, 2025, https://en.wikipedia.org/wiki/VAST_Data

- VAST InsightEngine with NVIDIA | Overview & Walkthrough — YouTube, дата последнего обращения: сентября 21, 2025, https://www.youtube.com/watch?v=MD5q6x0wfXg

- VAST Data Allies With NVIDIA to Create Integrated RAG Platform …, дата последнего обращения: сентября 21, 2025, https://techstrong.ai/articles/vast-data-allies-with-nvidia-to-create-integrated-rag-platform/

- VAST Data Expands Platform to Unify Structured and Unstructured Data — HPCwire, дата последнего обращения: сентября 21, 2025, https://www.hpcwire.com/off-the-wire/vast-data-expands-platform-to-unify-structured-and-unstructured-data/

- WEKA AI RAG Reference Platform, дата последнего обращения: сентября 21, 2025, https://www.weka.io/resources/reference-architecture/warrp-weka-ai-rag-reference-platform/

- The WEKA® Data Platform: The High-Performance Solution Redefining HPC and AI Workloads, дата последнего обращения: сентября 21, 2025, https://www.weka.io/resources/%20/the-weka-data-platform-the-high-performance-solution-redefining-hpc-and-ai-workloads/

- Accelerate Your AI Projects With The WEKA Data Platform | HPC User Forum, дата последнего обращения: сентября 21, 2025, https://www.hpcuserforum.com/wp-content/uploads/2025/04/Kevin-Tubbs_WEKA_Accelerate-Your-AI-Projects-With-The-WEKA-Data-Platform.pdf

- AI and Analytics in Operations Management | Hitachi IQ, дата последнего обращения: сентября 21, 2025, https://www.hitachivantara.com/en-us/solutions/ai-analytics

- Solution — A.I. & Machine Learning | Hitachi Vantara Federal, дата последнего обращения: сентября 21, 2025, https://www.hitachivantarafederal.com/what-we-do/solutions/ai-analytics/

- Hitachi Vantara Introduces Hitachi iQ M Series, a Modular Design with Hybrid Cloud Data Orchestration for GenAI and Industry-Specific Workloads, дата последнего обращения: сентября 21, 2025, https://www.hitachivantara.com/en-us/news/gl250318

- Hitachi Vantara Announces Collaboration with NVIDIA to Create New Portfolio of Industrial AI Solutions, дата последнего обращения: сентября 21, 2025, https://www.hitachi.com/New/cnews/month/2024/03/240319d.html

- Discovering the Potential of Your AI Initiatives and Applications to Achieve GenAI Success, дата последнего обращения: сентября 21, 2025, https://www.hitachivantara.com/en-us/blog/discovering-potential-of-your-ai-initiatives-applications-to-achieve-genai-success

- Hitachi Vantara unveils AI infrastructure with Nvidia BasePOD certification — Blocks and Files, дата последнего обращения: сентября 21, 2025, https://blocksandfiles.com/2024/07/26/hitachi-vantara-delivers-first-hitachi-iq-ai-offering/

- Driving Innovation with NVIDIA AI Data Platform: A View from Hitachi Vantara, дата последнего обращения: сентября 21, 2025, https://www.hitachivantara.com/en-us/blog/driving-innovation-with-nvidia-ai-data-platform-view-from-hitachi-vantara

- Hitachi promises time travel for LLMs – just don’t lose your RAG …, дата последнего обращения: сентября 21, 2025, https://blocksandfiles.com/2025/06/06/hitachi-promises-time-travel-for-llms-just-dont-lose-your-rag/

Hitachi Vantara Expands Hitachi iQ AI Infrastructure With Nvidia HGX Platform — CRN, дата последнего обращения: сентября 21, 2025, https://www.crn.com/news/storage/2024/hitachi-vantara-expands-hitachi-iq-ai-infrastructure-with-nvidia-hgx-platform

Добавить комментарий

Комментариев пока нет